Resumen

Este artículo ubica el concepto de «inteligencia» en el uso del término «inteligencia artificial» (IA) dentro de la tradición inglesa, alejado de nuestra comprensión del lenguaje común donde, aparece como un eufemismo. Para ello revisaremos nuestros usos de la palabra «inteligente», asociada a la figura del «hombre prudente» (phrónimos) en Aristóteles. Luego aludiremos a la propuesta de Javier Echeverría para identificar a la IA dentro de la empresa tecnocientífica. Antes, señalaremos la figura de Maxwell Smart, reconocido como un antecedente profético por los propios creadores de la IA, que serviría para reforzar la idea de que el concepto de «inteligencia», responde a un uso espurio del término.

¿En qué sentido son «inteligentes» los Servicios de Inteligencia?

Para investigar acerca de la procedencia del término «inteligencia» para nombrar al espionaje, en el término «servicios de inteligencia», como corresponde a los tiempos que corren, se lo preguntamos a la IA. Nos contesta que los primeros usos registrados se ubican en el Siglo XVI en Inglaterra. En inglés, el término intelligence comenzó a usarse como sinónimo de espionaje o noticias secretas alrededor de la década de 1580. Al parecer, la reina Isabel I de Inglaterra ya utilizaba la palabra intelligence para asuntos relacionados con la gestión de información secreta para proteger al reino. En 1587, el documento The Arte Of Warre de William Garrard mencionaba la oficina del «Master of the Intelligences». Para esa época los espías eran nominados como intelligencers. Luego el término se extendió al periodismo, lo que justifica que hubo periódicos llamados The Intelligencer. El uso del término «Inteligencia Militar» se consolidó entre los siglos XIX y XX. Organizaciones como la Office of Naval Intelligence (1882) en EE. UU. fueron pioneras en usar el nombre oficialmente, nos dice la IA.

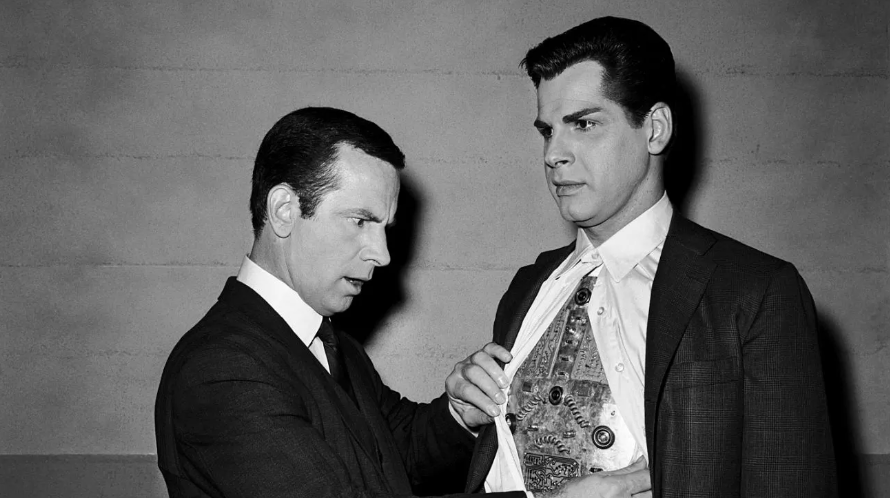

¿Qué hacen los «servicios de inteligencia» que se relaciona con la IA? La IA contesta: «ambos procesan grandes volúmenes de datos, en vista al interés por reconocer patrones de conducta con valor predictivo para la toma de decisiones». Respecto a la relación entre Maxwell Smart (Get Smart, el Superagente 86) y la IA, se lo valora como una profecía de la tecnología digital. En los años 60, bajo las condiciones de la «guerra fría» proliferaron los agentes de inteligencia de ficción que novelaban la figura del espía. En el caso de la serie «El superagente 86» era una parodia satírica, pero a la vez legitimadora. Los defensores del Bien, desde una agencia llamada «Control», combatían a las fuerzas del Mal, en este caso encarnada en otra organización identificada como «Kaos». La superioridad tecnológica para el espionaje hacía la diferencia para que, en cada capítulo, triunfara el Bien sobre el Mal a pesar de las torpezas del protagonista y su fiel compañero, el androide Hymie, en español Jaime.

La serie adelantó la existencia de dispositivos que hoy son de uso común. El zapatófono profetizó el uso de la telefonía móvil (Smartphone), el reloj que funcionaba como asistente informático (Smartwatch) anticipó a Siri de Google y los sensores para automatizar el funcionamiento de todo tipo de objetos también son antecedentes de las actuales formas de automatización a través de tecnología digital. Como exponente de la presencia de este culto a Maxwell Smart y la tecnología que colaboraba en sus acciones de espionaje, actualmente la empresa Motorola desarrolla el «Project Maxwell», un prototipo de asistente personal de IA programado para resumir conversaciones, capturar fotos y proporcionar información en tiempo real sobre lo que consulte el usuario.

El robot Hymie (Jaime), un androide puesto al servicio de Maxwell Smart, también es objeto de culto para los creadores de la IA ya que poseía una fuerza sobrehumana, pero resultaba muy peligroso porque interpretaba literalmente el lenguaje con resultados adversos y delirantes. Esta limitación para la comprensión del lenguaje natural todavía persiste en la IA, aunque los avances en este sentido son cualitativos. Como vemos en la serie, la inteligencia artificial de Jaime producía todo tipo de situaciones inadecuadas para el cumplimiento de las órdenes de Smart ya que ante la expresión «dame la mano», actuaba desenroscando una de sus manos para luego entregarla. Podríamos decir que Jaime desconocía las reglas pragmáticas (no las sintácticas o semánticas) necesarias para interpretar la orden «dame la mano» como petición de un gesto de saludo o de amistad. Para profundizar en esta incapacidad de la IA en el uso del lenguaje vamos a referirnos al uso de la razón práctica, de la prudencia o phrónesis, tal como la expone Aristóteles para sostener que la IA carece de esta exigente capacidad, eminentemente humana, aunque no siempre ejercida por los seres humanos.

Aristóteles, la figura del hombre prudente (phrónimos)

Aristóteles no inventó la Lógica formal, base de la IA, pero sí la sistematizó a partir de la determinación de reglas deductivas y del uso de la razón teórica, pero no acabó allí su aporte a la caracterización de la inteligencia humana, sino que identificó el uso de la razón práctica. La razón teórica es algorítmica, actúa según reglas deductivas (silogismos teóricos) y su ejercicio está orientado al logro de la sabiduría (sophía) y a la producción de ciencia (episteme). La razón práctica, en cambio, no es algorítmica, actúa según razonamientos no deductivos, el silogismo práctico concluye en una acción y no en una proposición y está orientada al logro de la prudencia (phrónimos) y a la acción ética y política. A diferencia de la episteme (conocimiento verdadero), la razón práctica se fundamenta en la doxa (opinión, creencia), sobre lo que puede fundamentarse de distintas maneras u opiniones. Aquí el valor no es la verdad sino la utilidad para el logro de algún fin. Aristóteles se interesa por señalar a quién la gente denomina «hombre prudente», en lugar de definir qué es la prudencia. Así es como señala a «Pericles y los que son como él», es decir, a los líderes, los que se ocupan de lo público, del orden social (Aristóteles, 1970, Libro VI, 5, p, 93). En este punto, Aristóteles toma distancia de la idea del «filósofo-rey» de Platón para indicar que quien gobierne el Estado debe ser él mismo un hombre experto en el conocimiento de los asuntos humanos, ya que ha de fijar los fines y promover, con sus acciones virtuosas, la virtud de los ciudadanos. No alcanza con el saber teórico, sino que hay que ser capaz de realizarlo (Varela, 2014, p.109). La razón práctica, como la razón teórica, funciona a partir de un marco normativo, pero sus reglas responden a la formación de un carácter a partir de la instalación de hábitos. Estos principios no derivan de un concepto único del Bien, por el contrario, Aristóteles rechaza la teoría de la Idea del Bien socrático-platónica para concebir a los principios prácticos como el resultado de prácticas sociales dentro de una comunidad, identificables a través del uso de un lenguaje. Así, no se delibera sobre los fines sino sobre los medios para llegar a esos fines. Los fines de la razón práctica, no son deliberativos, no resultan de la conclusión de ningún silogismo (ni teórico ni práctico), resultan de la sedimentación de las tradiciones y de los modos de vida aceptados como “buenos” en una comunidad. Sobre la base de estos principios es que el hombre prudente toma decisiones en cada situación particular. Los marcos normativos de la razón práctica derivan de las costumbres y los hábitos, distintos donde rigen costumbres distintas. La prudencia opera como un principio de racionalidad práctica (Varela, 2014, p.188) que, junto con la razón teórica determina la racionalidad humana pero no queda reducida una a la otra. En el Libro VI de la Ética a Nicómaco afirma que la prudencia (phrónesis) no puede adquirirse como el conocimiento de la geometría, de manera teórica. Aquí Aristóteles, a diferencia de Platón, muestra una nota fundacional del empirismo, pero reservada a la vida práctica: el hombre prudente necesita de la experiencia compartida en la vida social, a lo largo de toda su vida, para adquirir esta capacidad de elegir lo bueno. Para llegar a ser un hombre virtuoso, en el sentido de obrar según lo indica la racionalidad práctica, se necesita un complejo proceso de socialización, adquirir destrezas en el uso del lenguaje y en el autodominio de las acciones. El conocimiento práctico, es decir, la phrónesis, se adquiere a partir de una praxis y no a partir de la elaboración de una teoría, como la episteme, pero tampoco es una mera opinión, supone una elaboración intelectual y es definida como “una virtud intelectual (dianoética)”. Aristóteles reserva el concepto de “praxis” para caracterizar la “capacidad de actuar” en contraposición a la técnica, que es la capacidad de “producir” (poiesis) y a la contemplación que es la capacidad de teorizar (Zagal et al, 1996, p.72). A partir de este concepto de “praxis” desarrolla una teoría de la acción humana que luego será reelaborada, discutida o impugnada a lo largo de la historia de la filosofía, hasta nuestros días.

Para Aristóteles no puede haber praxis sin logos (sin seguir alguna regla), pero, ¿podría haber logos sin praxis? Para Aristóteles podría ser, como en el caso del sabio, que no necesariamente es virtuoso ni prudente, investiga acerca de cosas difíciles y divinas, pero que son inútiles como medios para conseguir un fin, no buscan los bienes humanos (Aristóteles, 1970, Libro VI, 7, p.94). Aquí destaca el peligro que representa para el orden social delegarle, a quien solamente está familiarizado con las demostraciones algorítmicas, el manejo de la política. El conocimiento de lo verdadero y lo falso no garantiza el conocimiento de lo bueno y lo malo para sí mismo ni para los demás. Aquí cita el caso de Anaxágoras y Tales y los que son como ellos, que la gente reconoce como sabios. La tradición reprodujo la idea de que fueron ineptos para preservar su propio bien. También los jóvenes pueden saber geometría y matemáticas y ser sabios, en ese sentido, pero no prudentes porque les falta experiencia compartida en el esfuerzo por interactuar con otros de manera virtuosa, es decir, arbitrando los medios para alcanzar un objetivo que preserva el bien común. En este punto podríamos decir que el lenguaje es el resultado de una praxis social, del largo adiestramiento, en una comunidad de hablantes. Sin este ejercicio, no hay conducta inteligente ya que no hay parámetros para valorar el uso de la prudencia en las tomas de decisiones.

Javier Echeverría y el rechazo al eufemismo «inteligente» para la IA

Para criticar o bendecir estas tecnologías, en principio, hay que saber qué son y qué efectos proyectan sobre la sociedad. En este sentido, Javier Echeverría es pionero en el análisis de lo que llama «tecnociencia», desde los años 90, en que puso en tela de juicio la supuesta neutralidad valorativa de la ciencia y denunció lo que llamó «la política del avestruz», que consiste en esconder la cabeza para no darse por enterado de los efectos destructivos de las innovaciones tecnocientíficas, donde priman los valores económicos y militares. Frente al ideal de la ciencia neutra, con su separación estricta entre hechos y valores, su enfoque puede considerarse una «axiología de la tecnociencia», ya que busca herramientas conceptuales para dilucidar los modos de producción tecnocientífica que caracterizan a esta nueva etapa en la producción de conocimientos (Ambrosini y Beraldi, 2018, pp. 527-536). Desconocer este complejo entramado de valoraciones en tensiones y pugnas implica restar elementos para juzgar la actividad tecnocientífica, que Echeverría revisa críticamente desde el análisis del Tercer Entorno y el concepto de Tecnopersonas. Respecto al término «inteligencia artificial» señala que, en español, a diferencia del inglés, el término «inteligente» guarda el sentido de «intelligere» que podría interpretarse como «entender con otros». En vista a esta capacidad eminentemente humana, Echeverría propone afirmar el valor epistémico y social del entendimiento mutuo también entre animales y humanos, que es previo a la predicción y la explicación (Echevería, 2023b).

Para Echeverría y Almendros (2023a, 2024), los programas de la familia CHATGPT son «tecnopersonas colectivas» porque, para operar, sus algoritmos necesitan la información que proviene de tecnopersonas individuales y la organizan según técnicas geométricas y probabilísticas bayesianas, a diferencia de las IA tradicionales, que solamente organizan y clasifican datos. En estos lenguajes, para suplir el déficit semántico, ya que no participan del uso social del lenguaje, como los usuarios humanos, el significado es consecuencia de una probabilidad bayesiana, afinada por el entrenamiento. El sistema ni «autoaprende» ni se autorregula, por lo que difícilmente se le puede considerar autónomo; perfecciona sus resultados/respuestas en términos de rapidez, eficacia y eficiencia, pero en ningún caso son aplicables criterios epistémicos y mucho menos cognitivos. Todavía menos criterios morales. (Echeverría, Almendros, 2023a, p. 258).

En apoyo a sus afirmaciones acerca del rechazo al eufemismo «inteligente» para nombrar estas innovaciones informáticas, Echeverría cita el Libro Blanco sobre la Inteligencia Artificial, publicado por la Comisión Europea el 19 de febrero de 2020 en Bruselas. Allí define la llamada IA como «Predicción artificial estadística bayesiana». El nombre «predicción artificial» no genera impacto, no equipara las capacidades de los algoritmos al genio de Einstein, afirma Echeverría, quien actualmente se interesa por los programas informáticos que utilizan grandes modelos lingüísticos probabilísticos y algoritmos predictivos para un conjunto de objetivos específicos (Large language models). Otra nota característica es que, a diferencia de las inteligencias humana, animal, vegetal, estas innovaciones digitales están privatizadas y patentadas, son una mercancía más donde la exageración de sus potencialidades es una exitosa estrategia de marketing, pero está lejos de representar lo que supone la inteligencia humana. Los autores señalan que el valor comercial de estas tecnologías se incrementa cuanto más entrenamiento adquieran y más amplia es la base de datos que tienen a su disposición. Cuanto más usado sea el CHATGPT, más acertadas serán sus producciones. Los datos, apropiados sin pedir permiso, aumentan el rédito comercial para los dueños de estas tecnopersonas colectivas que son, a su vez, personas jurídicas dueñas de las patentes de estas marcas.

Conclusión

En los manuales de Epistemología se caracteriza a la profecía autocumplida como una predicción que crea las condiciones para que la predicción se cumpla. En este caso, la ficción anticipó e inspiró una realidad que ya estaba en ciernes. En los años 50 el desarrollo de la IA ya estaba en marcha. En ese mismo año Alan Turing escribió para la Revista Mind el artículo publicado en octubre de 1950 bajo el título «Computing Machinery and Intelligence» donde presenta lo que llama «el juego de la imitación», hoy en día conocido como «el test de Turing», que serviría para comparar la inteligencia de las computadoras con la inteligencia humana. Desde entonces hasta ahora, el término «Inteligencia artificial» ha creado grandes expectativas y sus cultores y promotores auguran un futuro donde es posible que la IA supere a la inteligencia humana.

En contra de las imágenes optimistas acerca de las IA, Echeverría propone dedicarnos a revisar críticamente estos temas porque, en contra de la imagen reduccionista, instalada de manera hegemónica por los medios de comunicación, estas innovaciones, como todas, tienen una potencialidad destructiva sobre algunas formas de vida dignas de ser preservadas (Echeverría, 2023b). Si entendemos por «inteligencia» la capacidad de procesar información, puesta al servicio de la acumulación de poder, ya sea económico o de liderazgo para la toma de decisiones geopolíticas, hacemos un uso espurio del lenguaje. Como vimos, la prudencia es parte de lo que llamamos «conducta inteligente». Esta capacidad está lejos de la imitación y repetición mecánica, también del mero cálculo de costos y beneficios motivados por el autointerés. Por el contrario, supone la mediación de la vida social, donde es fundamental la transmisión del conocimiento, a través de valores y modelos de conducta considerados «buenos» por la comunidad. Un ejercicio del que está privado la IA. En nuestros lenguajes naturales, consideramos inteligentes a las acciones que merecen una valoración positiva para la convivencia humana. En este sentido, no consideramos inteligentes a las acciones que conducen a la guerra ni a las que causan dolor o daño a otras personas, como el racismo, la misoginia, la misantropía o cualquier tipo de instigación al odio. Tampoco estas tecnologías son inteligentes desde el punto de vista ambiental. Cabe agregar que los algoritmos de la IA viven en «nubes» que consumen gran cantidad de energía, que producen calor y necesitan ser refrigeradas con más energía, con un alto costo ecológico (Echeverría, Almendros, 2023 a, p.462) En vista a estos y otros efectos negativos, Echeverría señala la necesidad de sacar este tema del enclaustramiento de los especialistas y llevarlo al debate público, ya que la IA puede actuar de manera tan imprudente como los humanos.

Bibliografía

Ambrosini, C., Beraldi G., (2018) Pensar la ciencia hoy. La epistemología: entre teorías, modelos y valores, Buenos Aires, C.C.C Editorial Educando.

Aristóteles, (1970) Ética a Nicómaco, Madrid, Instituto de estudios políticos.

Echeverría, J., (2010) De la filosofía de la ciencia a la filosofía de la tecnociencia, en Revista Internacional de Filosofía, Nº 50, pp.31-41

Echeverría, J., Almendros, L. (2023 a) Tecnopersonas. Cómo las tecnologías nos transforman, 2da edición, Gijón, Trea Ensayos.

Echeverría, J., Almendros, L, (2024) “Inteligencias artificiales colectivas: un enfoque europeo”, Montevideo, CUADERNOS del GESCyT – Año 1, Número 1, Setiembre 2024.

Echeverría, J., (2023 b) Tecnociencias, inteligencias artificiales e innovaciones, presentación en UNAM, México, noviembre de 2023.

disponible en https://www.youtube.com/watch?v=4Xa3qxAF0ho. Consultado 20 de enero de 2026.

Varela, L., (2014) Filosofía práctica y prudencia, Buenos Aires, Biblos-UNLa.

Zagal, H., Aguilar Álvarez, S., (1996) Límites de la argumentación ética en Aristóteles, México, Publicaciones Cruz.

*Cristina Ambrosini es Doctora en Filosofía (UBA), investigadora (UBA – UNLa) Actualmente es Editora Científica de la Revista Perspectivas Metodológicas UNLa. Miembro de asociaciones: Sociedad Argentina de Bioetica y DDHH, Asociación Iberoamericana de Filosofía de las Ciencias y las Técnicas (ASIFICyT), Asociación Argentina de Investigaciones Éticas (AADiE), Red internacional Lúdica y Juego.

Cómo citar este artículo: Ambrosini, C. (11 de marzo del 2026). Maxwell Smart y la IA. La profecía autocumplida. Investigación en Movimiento. Recuperado el [incluir fecha de consulta]. https://investigacionenmovimiento.unla.edu.ar/maxwell-smart-y-la-ia-la-profecia-autocumplida/